AI Forensics’in son araştırması, kadınlara ve kız çocuklarına ait rızaya dayalı olmayan mahrem görüntülerin ve çocukların cinsel istismarına yönelik materyallerin yayılması ve paraya çevrilmesi üzerine kurulu organize Telegram ağlarını ortaya çıkarttı. İtalya ve İspanya genelinde yaklaşık 25 bin kullanıcının yer aldığı bu Telegram ağlarını inceleyen araştırmacılar, altı hafta boyunca 16 grubu ve kanalda paylaşılan 2.8 milyon mesajı analiz etti.

Rapora göre paylaşılan medyanın yüzde 74’ünü fotoğraflar, yüzde 25’ini videolar ve yüzde 1’ini ses ve diğer dosya türleri oluşturdu. Araştırmacılar, her iki ülkede incelenen Telegram grupları ve kanallarının yalnızca kadınlara ve kız çocuklarına ait rızaya dayalı olmayan cinsel içerikleri paylaşmak için değil, aynı zamanda kadınları ve kız çocuklarını çevrimiçi ortamda kontrol etmek, aşağılamak ve küçük düşürmek amacıyla da kullanıldığını ortaya koydu.

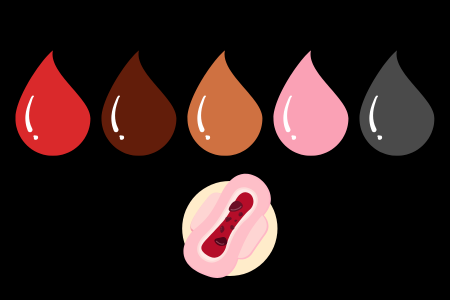

Mağdurların büyük çoğunluğunu kadınlar oluştururken, paylaşılan bağlantılar üzerinden kimlik tespiti de yapılabildiği raporda yer aldı. İçeriklerde çocukların cinsel istismarına yönelik materyaller, ensest ve tecavüz tasvirlerinin de yer aldığı belirtildi. Bunun yanı sıra, “nudify” (çıplaklaştırma) botları aracılığıyla yapay olarak üretilmiş görüntülerin de elde edilerek satıldığı ifade edildi.

Failler kim?

Araştırma faillerin genellikle genç erkeklerden oluştuğunu gösterdi. Bu kişiler arasında görüntüleri paylaşılan kadınların partnerleri, tanıdıkları, arkadaşları ve eski partnerleri de yer aldı. İçeriğin organize edilmesi ve satışı için ise Telegram altyapısı kullanıldı. Satışlar, hayat boyu erişim için 20-50 avro arasında değişen ücretlerle ya da aylık yaklaşık 5 avro abonelik sistemiyle gerçekleştirildi. Ödemeler Apple Pay, Bizum, PayPal ve kripto para birimleri gibi çevrimiçi transfer yöntemleriyle yapılırken raporda bu yöntemlerin bir kısmının izlenebilir olması nedeniyle konunun daha ayrıntılı araştırılması gerektiği vurgulandı.

AI Forensics, araştırmanın ortaya koyduğu bulguların platformlardaki sistematik yetersizlikleri gösterdiğini belirterek, bu sorunların giderilmesi için Avrupa Birliği’nin daha güçlü adımlar atması gerektiğini vurguladı. Araştırmacılar, Telegram’ın Dijital Hizmetler Yasası (DSA) kapsamında “çok büyük çevrimiçi platform” olarak değerlendirilmesi ve AB Yapay Zeka Yasası çerçevesinde bu tür istismarların önlenmesine yönelik daha etkili önlemler alınması gerektiğini vurguladı.

Yeni nesil cinsel şiddet

Konuya ilişkin gazetemize konuşan İstanbul Barosu Bilişim Hukuku Komisyonu Başkanı Av. Fehmi Ünsal Özmestik, bugün karşı karşıya kalınan durumun bir sosyal medya taşkınlığı değil; özellikle kadınlar ve çocuklar başta olmak üzere her bireyin bedeni, görüntüsü ve kimliği üzerinden kurulan yeni nesil bir cinsel şiddet olduğunu belirtti. Özmestik, bu suçun yapay zeka teknolojileri tarafından icat edilmediğini belirterek, “Bir başka ifade ile suçu teknolojiye atmak en basit tabir ile gerçek faili görünmez kılan, sorumluluğu sulandıran ve çözümü geciktiren bir kaçış refleksi olur. Artık mağdur olmak için özel bir fotoğraf paylaşmış olmanız da çok gerekmiyor. Günlük hayatta çekilmiş sıradan bir görsel dahi birkaç dakika içinde müstehcenleştirilebiliyor, sonrasında yayılabiliyor” ifadelerini kullandı.

Özmestik, bir kişinin rızası dışında görseli ile oynanması, görsel veya videoların ilgili kişinin rızası olmaksızın paylaşılmasının hem hukuka aykırı hem de suç teşkil ettiğini vurguladı.

Kadınlar ve çocuklar nasıl korunmalı?

Bu suç sonucu mağdur olmuş kişilerin itibar kaybı, korku, sosyal izolasyon, psikolojik travma ve yeniden mağduriyet gibi birçok sonuçla karşı karşıya bırakıldığını belirten Özmestik, “Önlem tarafında ise yalnızca mağdura yüklediğimiz klasik öneriler yetersiz kalmaktadır. ‘Fotoğraf paylaşmayın’, ‘Görünmeyin’ yaklaşımı çözüm değildir; çünkü yeni dönemde saldırgan, sıradan görüntülerden sahte cinsel içerik üretebilmektedir. Bu nedenle önleme yükümlülüğü esasen platformlar, yapay zeka geliştiricileri, kamu otoriteleri ve eğitim kurumları üzerinde olmalıdır” dedi.

Kadınların ve çocukların korunması için beş eksenin öne çıktığını belirten Özmestik, bu önlemleri şu şekilde sıraladı:

• Hızlı kaldırma ve delil koruma mekanizması: Mağdur tek başvurusuyla eş zamanlı kaldırma, hash eşleştirme ve yeniden yüklemeyi engelleyen sistemler kurulmalıdır.

• Ceza hukuku ve usul hukuku güncellemesi: Rıza dışı görüntü ve video paylaşımı, deepfake cinsel içerik üretimi, çocuklara ilişkin yapay ve suç teşkil eden içeriklerin hızla dolaşımdan çıkartılabilmesi için 24 saat aktif olan bir birim kurulmalıdır.

• Özel mağdur destek birimleri: Kolluk, savcılık, barolar, aile ve sosyal hizmetler birimleri ile çocuk izleme merkezleri arasında koordineli bir müdahale hattı kurulmalıdır.

• Eğitim: Çocuklara ve ebeveynlere dijital mahremiyet, siber zorbalık, veri güvenliği noktasında okullarda eğitimler verilmelidir.

• Teknik üreticilere yükümlülük: Model geliştiricileri ve cinsel manipülasyon amaçlı kötüye kullanımı önleyen filtreler, kullanım kısıtları, filigranlama ve kötüye kullanım tespiti noktasında teknik üreticilere çeşitli teknik yükümlülükler getirilmelidir.”

Türkiye özelinde de konunun yalnızca “Özel hayatın gizliliği” ya da “Kişisel verilerin korunması” ihlali gibi ele alınmasının yeterli olmayacağını belirten Özmestik, “Kadına yönelik dijital şiddet, çocuğun cinsel istismardan korunması, kişisel verilerin korunması ve platform sorumluluğu eksenlerini birlikte kapsayan bütüncül bir model kurulmalıdır. Emniyet-siber birimler, savcılıklar ve hakimler için deepfake, sentetik medya, içerik zinciri, platform raporlama ve sınır aşan delil toplama konularında uzmanlaşmış eğitim gerekir. Soruşturma makamı ile bu alana öze adli kolluk ile daha hızlı ve efektif sonuç alınması için çalışma yapılması gerekmektedir. Okullarda özellikle ortaokul ve lise çağında “dijital rıza”, “ekran arkasında suç”, “görüntü manipülasyonu” ve “ihbar mekanizmaları” anlatılmalıdır. Kadınlar ve çocuklar için çalışan STK’ler, barolar ve kamu kurumları arasında ortak başvuru ve süreç yönetimine ilişkin çalışmalar yapılmalıdır” ifadelerini kullandı. Dünya ölçeğinde ise uluslararası suç tanımı uyumu, platformlar arası müdahale standardı ve sınır aşan iş birliğinin kritik olduğunu vurguladı.

‘Dijital şiddet örgütlü, sınır ötesi bir insan hakları ihlalidir’

Türkiye Kadın Dernekleri Federasyonu (TKDF) Başkanı Canan Güllü ise araştırmanın ortaya koyduğu verilerin örgütlü, sistematik ve sınır ötesi bir şiddet biçimini ortaya koyduğunu vurguladı. Dijital ortamda gerçekleşen bu tür eylemlerin açıkça cinsel şiddet ve çocuklar söz konusu olduğunda çocuk istismarı kapsamında değerlendirilmesi gerektiğini belirten Güllü, “Dolayısıyla bu suçlara yönelik yaklaşım da aynı ciddiyet, kararlılık ve bütüncül politika araçlarıyla ele alınmalıdır” dedi.

Güllü öncelikle bu suçların doğru tanımlanmasının hayati önem taşıdığını belirterek kamuoyunda kullanılan “skandal” ya da “ifşa” gibi ifadelerin suçun niteliğini hafiflettiğini ve failin sorumluluğunu görünmez kıldığını belirtti.

Hukuki boyutta ise en temel sorunlardan birinin cezasızlık olduğunu dile getiren Güllü, “Dijital platformların sınır tanımayan yapısı, faillerin farklı ülkelerde faaliyet göstermesine olanak tanırken, mevcut ulusal hukuk sistemleri çoğu zaman bu suçlara etkili ve hızlı yanıt verememektedir. Bu nedenle, ülkeler arası iş birliği mekanizmalarının güçlendirilmesi, Avrupa düzeyinde ortak hukuki çerçevelerin etkin uygulanması ve platformların sorumluluğunun açıkça tanımlanması gerekmektedir” ifadelerini kullandı.

Platformlara içerik kaldırma yükümlülüğü getirilmesi, tekrar paylaşımı önleyecek teknolojik sistemler zorunlu hale getirilmesi ve bu yükümlülüklere uymayan şirketlere yaptırım uygulanması gerektiğinin altını çizen Güllü, “TKDF’nin sahadaki deneyimi açıkça göstermektedir ki mağdurların güçlendirilmesi ve desteklenmesi bu mücadelenin merkezinde yer almalıdır. Mahrem görüntüleri yayılan kadınlar ve çocuklar, yalnızca hukuki değil; aynı zamanda derin psikolojik travmalarla da karşı karşıya kalmaktadır. Bu nedenle, ücretsiz hukuki danışmanlık, psikolojik destek ve dijital içerik temizleme hizmetleri bir arada sunulmalı; güvenli başvuru mekanizmaları yaygınlaştırılmalıdır” dedi.

Bu sorunun uluslararası düzeyde bir insan hakları sorunu olarak ele alınması gerektiğinin altını çizen Güllü, dijital şiddetin farklı boyutlarını görünür kılmak ve ortak standartlar oluşturmak için uluslararası kurumlarla iş birlikleri kurulmasının önemli olduğunu belirtti. Özellikle çalışma hayatında dijital şiddetin ele alınması bağlamında Uluslararası Çalışma Örgütünün (ILO) C190 sayılı sözleşmesinin yeniden değerlendirilmesi gerektiğini belirten Güllü “Ayrıca teknoloji şirketleriyle yürütülecek diyalog süreçleri, yalnızca gönüllülük esasına dayanmamalı; bağlayıcı ilkeler ve denetim mekanizmaları içermelidir” ifadelerini kullandı. Güllü son olarak dijital şiddetin gerçek hayattan bağımsız olmadığını, aksine onun bir uzantısı olduğunu belirterek, “Bu nedenle, dijitalde işlenen her şiddet eylemi, aynı ciddiyetle ele alınmalı ve etkili biçimde cezalandırılmalıdır. Ancak kalıcı çözüm, yalnızca cezalandırmada değil; hukuki, teknolojik ve toplumsal dönüşümün birlikte hayata geçirilmesinde yatmaktadır” dedi.

Telegram’dan deepfake ve istismar iddialarına yanıt

Telegram sözcüsü Remi Vaughn, hazırladığımız habere ilişkin mail yoluyla bir cevap yazısı gönderdi. Vaughn, rızaya dayalı olmayan pornografi -deepfake de dahil olmak üzere- Telegram'ın hizmet şartları tarafından açıkça yasakladığını ve tespit edildiği anda da kaldırıldığını ifade etti. Platformun herkese açık bölümlerinin özel yapay zeka araçlarıyla donatılmış moderatörler tarafından izlendiğini ve kullanıcı bildirimlerinin değerlendirilerek her gün milyonlarca zararlı içeriğin kaldırıldığını belirten Vaughn, "Telegram, AB yasalarına ve Dijital Hizmetler Yasası kapsamında belirlenen tüm ilgili yükümlülüklere uymakta olup Avrupa Komisyonu ile sürekli iletişim halindedir" ifadelerini kullandı.

Telegram'ın yapısal olarak görüntü temelli cinsel istismarın ticarileştirilmesine veya ölçeklendirilmesine olanak sağladığı iddialarını reddettiklerini belirten Vaughn, "Platformumuzda bu tür istismarı özellikle kolaylaştıracak herhangi bir para kazanma özelliği bulunmamaktadır; nitekim ödemelerin PayPal, Bizum ve kripto para birimleri aracılığıyla yapılması bunu göstermektedir. Ayrıca platformumuz, zararlı materyallerin yayılmasını önleme konusunda VLOP’lara kıyasla daha etkilidir; zira bu tür içeriklerin yayılması için diğer platformların içerik öneri algoritmalarına ihtiyaç duyulmaktadır. Telegram’da bu tür algoritmalar bulunmamaktadır" dedi.

Fotoğraf: Octavian Grigorescu's Images/Canva

İlgili haberler

Dijital şiddete en çok kadınlar maruz kalıyor

Dijital şiddetin ne olduğunu, Türkiye ve dünyada nasıl tartışıldığını, neler yapılabileceğini İstanbul Barosu Bilişim Hukuku Komisyon Başkanı Şebnem Ahi anlattı.

Dijital şiddetin geldiği nokta: Veri sızıntıları kadınları vuruyor

Devlet ve özel şirketlerin sitelerden sızdırılan bilgiler kadınları şiddetin her türlüsüne açık hale getiriyor.

Çağımızın şiddeti: Dijital şiddet

Teknolojik araçlar kadını küçük düşürmek, cezalandırmak, denetlemek için kullanılıyorsa bu dijital şiddettir. Son yıllarda sosyal medya ile yaygınlaşan dijital şiddet biçimlerine bir göz atalım...

- EN SON

- ÇOK OKUNAN

- ÖNERİLEN